|

Главный вопрос при создании искусственного интеллекта состоит в том, как устроен процесс обучения.

1 путь:

Современные попытки создать ИИ основаны преимущественно на нейронных сетях,

и, надо признать эти попытки весьма эффективны и принесли свои плоды в целом ряде отраслей:

1)Беспилотные автомобили (компании Tesla и Google)

2)Распознавание образов (Google картинки)

3)Распознавание речи (Siri, OK Google)

4)Универсальный переводчик (Google переводчик)

Но у подхода к созданию ИИ на основе нейронных сетей есть целый ряд ограничений, вытекающих из самого смысла нейронных сетей. Что же такое нейронные сети?

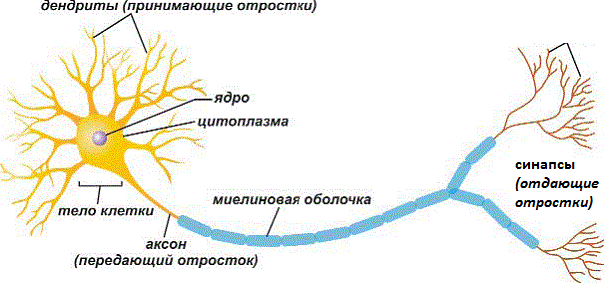

Это гигантский набор маленьких передатчиков сигналов - нейронов (в мозгу человека до 100 млрд штук), взаимодействующих друг с другом. Эти передатчики могут принимать и отдавать сигналы в соответствии с некоторой программой поведения.

Есть разные модели и разные программы, но по своей сути работа нейронных сетей может быть описана следующим образом: представьте себе человека, которому передали важные сведения - этот человек возбудился, получил импульс и начал пытаться искать кому бы эти важные сведения передать и распространить их как можно шире. И вот он начал подбегать ко всем на улице в попытках рассказать свое знание. Но кто-то очень сильно занят и не может ответить, кто-то может, но не понимает ищущего общения человека. Кто-то может и понимает - только не знает что дальше делать с этими сведениями и оказывается тупиковым адресатом. И лишь немногие смогут принять сигнал, понять сигнал и транслировать его дальше. Так же себя ведут нейроны. Они, получив сигнал, хаотично, случайным образом тыкаются ко всем подряд другим нейронам в попытках распространить сигнал дальше. Так выстраиваются цепочки нейронных связей - цепочки тех нейронов, которые смогли провзаимодействовать.

Ключевая проблема - случайное блуждание сигнала в поисках адресата может продолжаться слишком долго (миллионы лет) или может оказаться неуспешным вообще (в виду гибели нейрона или переключения его на другие задачи).

Т.е. еще раз - обучение, основанное только на нейронных сетях - слишком долгий путь и ненадежный путь в силу своей случайности.

Поэтому есть другие пути:

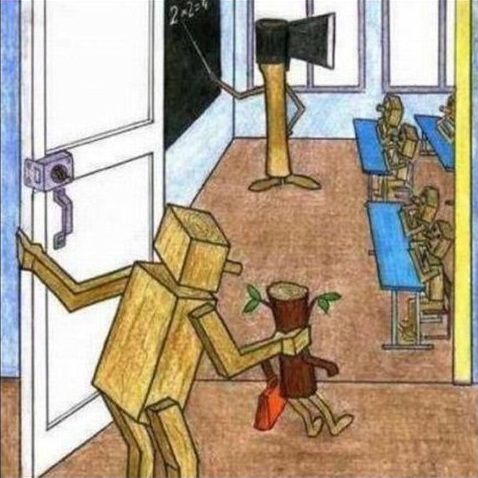

2 путь: повторение

Таким образом детей учат в школах в 90% случаев. Многократное повторение заранее продуманной программы ведет к ее усвоению. Но при этом отсутствует так называемый творческий элемент.

Разум, воспитанный на повторении, привыкает к этому и становится не способен к самостоятельному обучению через нейронные сети - долгому, но действенному пути. А так же не способен к анализу и структурирование информации - к 3-му пути, проложить который при создании ИИ и призвана технология Pangeya

3 путь: анализ структуры информации

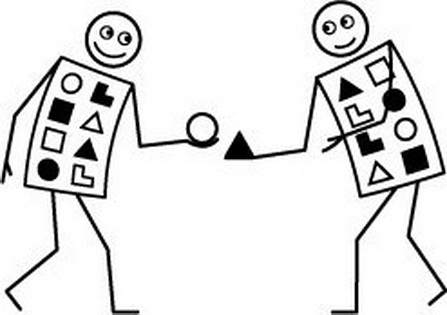

МЫШЛЕНИЕ ЕСТЬ СРАВНЕНИЕ! - вот она ключевая мысль всей технологии Pangeya: сравнение блоков информации через анализ структуры этой информации!

Чтобы родилась мысль, чтобы сигнал между нейронами прошел - необходимо заметить похожесть одного блока информации с другим!

Т.е. представим снова человека, бегающего по улице в попытке передать мысль - но разговаривающего на иностранном языке со всеми на улице - он не сможет этого сделать! Его просто никто не поймет! Но если человек говорит на одном с Вами языке или хотя бы на ПОХОЖЕМ, родственном языке - то у Вас уже есть шансы понять друг друга.

Так же и с искусственным разумом. Он принимает к рассмотрению 2 блока информации: и если находит их в чем-то похожими - создает связь. Если же они полностью различны - сравнивает другие блоки информации, пока связь не будет найдена.

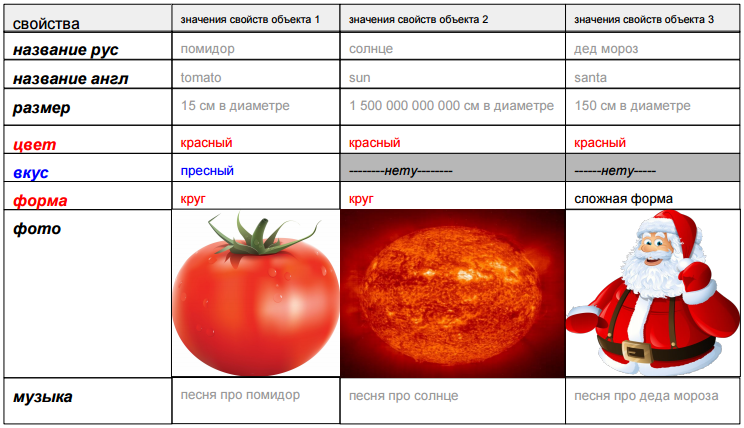

А структура информации может быть описана через объекты, наделенные свойствами. И именно через сравнение свойств мы можем сравнивать объекты между собой и устанавливать их похожести.

Люди никогда ничего не придумывают, и вообще придумать что-то невозможно. Можно наблюдать за окружающей реальностью, и сравнивать ранее запомненную информацию с информацией поступающей извне. Если мы обнаруживаем сильную похожесть имеющегося и пришедшего - рождается мысль=связь. А сравнение мы всегда неизбежно производим через анализ свойств объектов

Так, например из таблицы Выше видно, что Помидор и Солнце похожи друг на друга больше (по свойствам формы и цвета), чем дед Мороз и помидор (по свойствам цвета).

В заключение надо сказать, что все 3 вышеперечисленных способа обучения важны и нужны. И они должны применяться все 3 -только так можно добиться эффективного обучения.

Нейронные сети хороши - когда изучается что-то совсем новое, вообще неизвестное. Но это долго и ненадежно

Повторение и готовые алгоритмы хороши - там где интеллект надо предельно быстро и четко научить чему-то уже заранее известному.

А анализ структуры информации - просто жизненно необходим, когда нужно создавать новую информацию на основе ранее изученной за счет формирования связей=похожестей на основе анализа свойств объектов. Это и есть так называемое логическое мышление.

По существу все 3 пути - это проявление разных аспектов одного и того же процесса:

1)повторение: люди вносят в свои аккаунты известную им информацию, т.е. по сути повторяют то, что уже знают своему компьютеру

2)внесенная информация хаотично будет сравниваться по своей структуре с другой информацией описанной в тех же свойствах - тут работают нейронные сети, они будут осуществлять процесс поиска с кем бы провзаимодействовать

3)и наконец, на кончике пера - в момент контакта 2-х блоков информации, выбранных нейронной сетью, будет происходит сравнение объектов через их свойства

|